新闻中心

关注蓝耘了解更多咨询

12月,人工智能实验室OpenAI发布的对话式大型语言模型ChatGPT火出圈。

它不但可以高情商地与人对话,回答各种问题,还可以修改代码改bug、生成文本、帮忙写公众号甚至写小说、参加美国高校的入学资格考试(SAT)为中等学生水平、用《坎特伯雷故事集》风格改写了90年代热门歌曲《Baby Got Back》,它不但能指导AI作画,自己也能画。

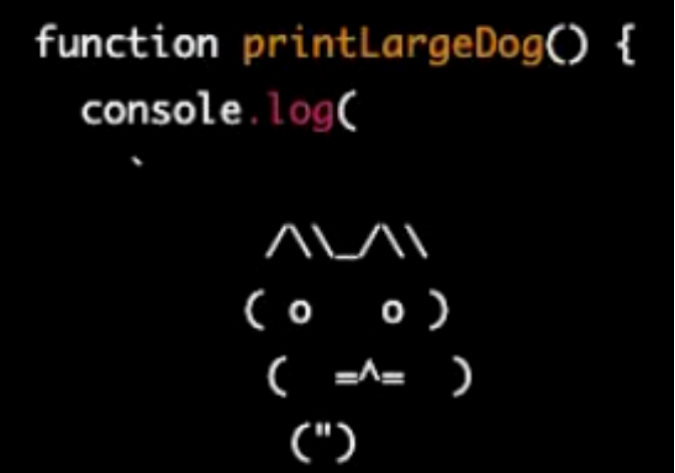

ChatGPT使用一段程序拼接出的小狗 (图源:澎湃新闻)

如此一款超神的自然语言生成式AI,使人们再次燃起了对AI大模型能达到何种水平的兴趣。ChatGPT一经推出,自11月30日至12月5日,用户数量已突破100万。

ChatGPT测试地址,大家可以体验一下ChatGPT的机智!https://chat.openai.com/auth/login

让ChatGPT介绍自己时,它回复道:“我是一个大型语言模型,已经过大量文本数据的训练,这使我能够对各种输入生成类似人类的响应。当你问我一个问题时,我会使用我的训练和一组算法来生成与你的问题相关并以自然的方式编写的回答。我尽我所能提供准确和有用的信息,但我不是一个完美的知识来源,我可能并不总是能够提供完整或正确的答案。”

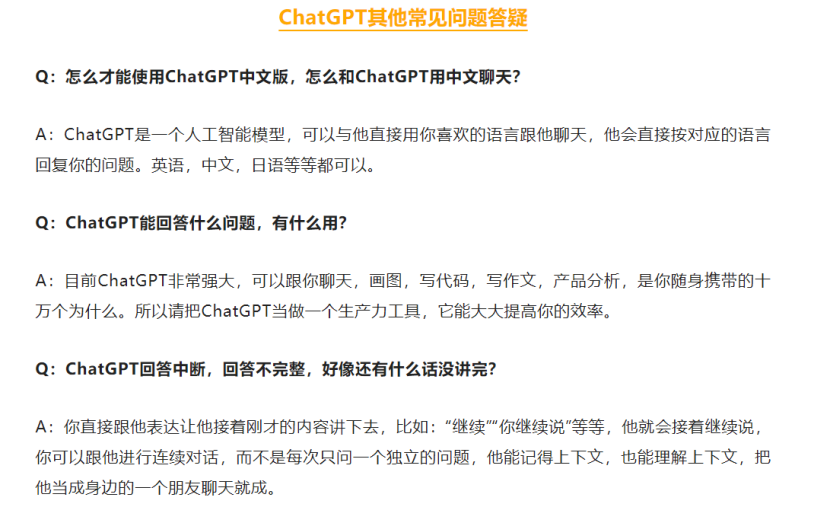

关于ChatGPT能做些什么 ( 图源:“ChatGPT入口”公众号)

在十项全能选手、史上最强聊天机器人ChatGPT引起热度的背后,代表的是以大量数据为基础训练出的通用大模型将成为未来AI领域的主流。

人工智能正在进入“大模型时代”。

中国人民大学高瓴人工智能学院执行院长文继荣给出的大模型定义为:AI大模型就是Foundation Model(基础模型),指通过在大规模宽泛的数据上进行训练后能适应一系列下游任务的模型。

以往针对人工智能的不同场景需要开发不同的模型,开发者在一定算力和数据的基础上使用开源算法框架训练智能模型,导致模型开发相对零碎,开发出的模型用途有限而开发的技术成本高昂。

一千个人工智能的应用场景就有一千个小模型。零碎、微观的小模型不适应于人工智能具体场景的丰富和细化趋势,对通用性模型的需求是AI行业迫切需要解决的问题。

从2020年开始,全球各大人工智能公司和科研机构开始了大模型开发。2020年,OpenAI推出超大规模语言生成模型GPT-3,它能写文章,做翻译,还能生成代码,甚至可以学习一个人的语言模式,并遵循这个模式与人进行谈话。

GPT-3在ChatGPT之前,也被称为史上最能聊、最会聊的AI模型,然而有时候也会出现一些编造扭曲事实、生成有偏见或有害的文本,这也是后续推出新的大模型的必要改进之处。GPT-3拉开了AI大模型的研发大幕,2021年谷歌发布了Switch Transformer,微软和英伟达也推出了包含5300亿个参数的自然语言生成模型。

国内企业相继推出自己开发的AI大模型,加入到AI的新赛道中去。2020年到2021年,中国大模型数量从2个增至21个,基本与美国处于同等量级,大幅领先于世界其他各国。在此期间,国内还出现了基于昇腾的鹏程、盘古、紫东、太初、悟道等千亿甚至万亿级别的大模型。

中国科学院自动化研究所所长徐波在接受《科技日报》采访时曾说:“人工智能正处于从“可以用”逐渐走向“好用”的落地应用阶段,但目前仍处于商业落地早期,主要面临着场景需求碎片化、人力研发和应用计算成本高、模型算法从实验室场景到真实场景效果差距大等行业痛点。大部分AI项目落地还停留在“手工作坊”阶段。”

就目前人工智能从“有的用”“可以用”走向“好用”阶段,AI大模型通过“模型预训练”与“下游特定任务模型微调”的方式,提供基于模型的通用化解决方案,适应多样化的具体应用场景,解决AI在赋能中面临的碎片化、多样化问题,拓展了模型的泛化性、通用性、实用性,有效降低了开发成本与适配成本。

中国信息通信研究院云计算与大数据研究所人工智能部副主任曹峰在接受《人民邮电报》采访时介绍:AI大模型的发展经历了多个重要阶段。从参数规模上看,AI大模型先后经历了预训练模型、大规模预训练模型、超大规模预训练模型三个阶段,参数量实现了从亿级到万亿级的突破。从模态支持上看,AI大模型从支持图片、图像、文本、语音单一模态下的单一任务,逐渐发展为支持多种模态下的多种任务。在各阶段的衍变过程中,涌现出多个具有代表性的AI大模型。

当前,AI产业的底层模块不断增强,AI大模型在面向实际任务建模前需在海量通用数据上进行预先训练,加之套用小模型以及具体优化微调,使得人工智能行业形成了AI芯片+算力基础设施+AI 框架算法库+应用场景的模式,突破传统AI模型难以泛化的局限,同时反哺AI底层架构和算力基础设施。

目前,我国算力赋能数字经济新篇章,算力创新能力不断提升,智能算力增长迅速,成为算力规模扩大中的主要动力,而这正是依托于人工智能领域创新的力量不断增强。

作为GPU算力云服务商,蓝耘以IT系统集成为基础,以算力云服务为核心,依托自有智算云平台,为客户提供包括GPU虚拟云主机、HPC平台、裸金属GPU服务器等在内的产品/服务。蓝耘的算力服务,面向多样化需求的 AI应用场景,如机器学习、AI大模型开发数据训练、计算机视觉等前沿科技领域,提供算力服务,为AI企业的计算开发、模型训练提速赋能。

参考:人民邮电报《AI大模型:以“大规模预训练﹢微调”范式满足多元化需求》