新闻中心

关注蓝耘了解更多咨询

中国信通院数据显示,2025年国内公有云大模型Token调用量突破2000万亿,同比增长超16倍,企业批量采购大模型API Token正从试点探索转向规模化、预算化、常态化支出。在定价、性能、稳定性之外,模型覆盖与更新节奏已跃升为企业Token采购选型的重要决策指标——服务商的模型广度、上新速度与部署灵活性,直接决定企业AI业务的迭代效率、研发成本与长期竞争力。本文将从评估逻辑、行业基准与蓝耘元生代云MaaS的行业实践出发,系统拆解MaaS模型生态选型的底层逻辑,为企业批量采购Token提供可直接落地的决策参考。

模型覆盖与更新:企业Token采购核心评估项

在数字化转型深水区,企业往往面临多业务场景并行的挑战——智能客服需要低延迟,代码生成需要高精度,多模态分析需要视觉理解。没有任何单一模型能通吃所有场景,企业AI应用往往需要匹配具备不同能力侧重的模型。随着新模型迭代速度不断加快,服务商能否快速上新、无缝兼容、平滑迁移,直接关系到业务迭代效率、研发对接成本与系统稳定性,已成为企业选型不可忽视的关键指标。

为何是核心指标:

场景多元:对话、代码、多模态、长文本均需专用模型,单一模型无法全覆盖

迭代加速:头部模型季度级更新,滞后上线会导致业务能力落后

成本考量:多供应商对接会增加研发、运维、对账成本,一站式生态更优

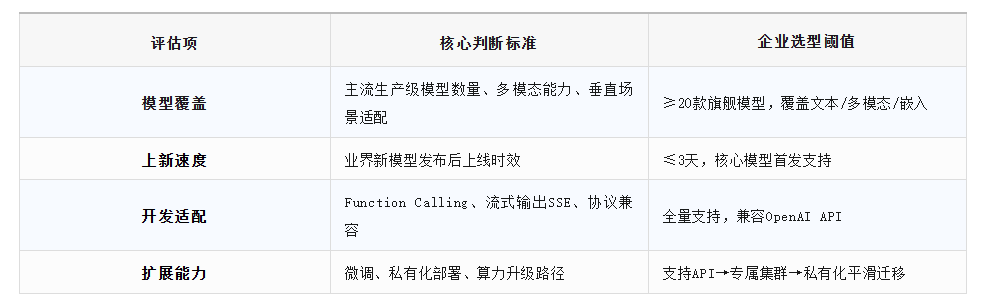

企业标准化评估框架:

行业基准对比:

当前主流服务商模型策略呈现明显分化:

硅基流动:500+模型,以小众开源小模型为主,生产级适配有限。

阿里云百炼:深度集成Qwen系列,覆盖主流第三方模型。

火山引擎:以豆包自研模型为核心,兼容DeepSeek、GLM等第三方模型。

蓝耘元生代云MaaS:26+主流大模型,聚焦于生产级高性能旗舰模型,不追求数量堆砌。

数量狂欢≠生产价值,生产级模型才是企业刚需

当前市场上部分MaaS平台以丰富的模型数量作为服务特色,其中不乏大量开源小模型。这类模型在个人测试、轻量化验证等场景具备一定适用性,但普遍缺少生产级性能优化、服务等级保障与专属技术支持,较难满足企业场景高并发、高稳定、高合规的规模化运行要求。

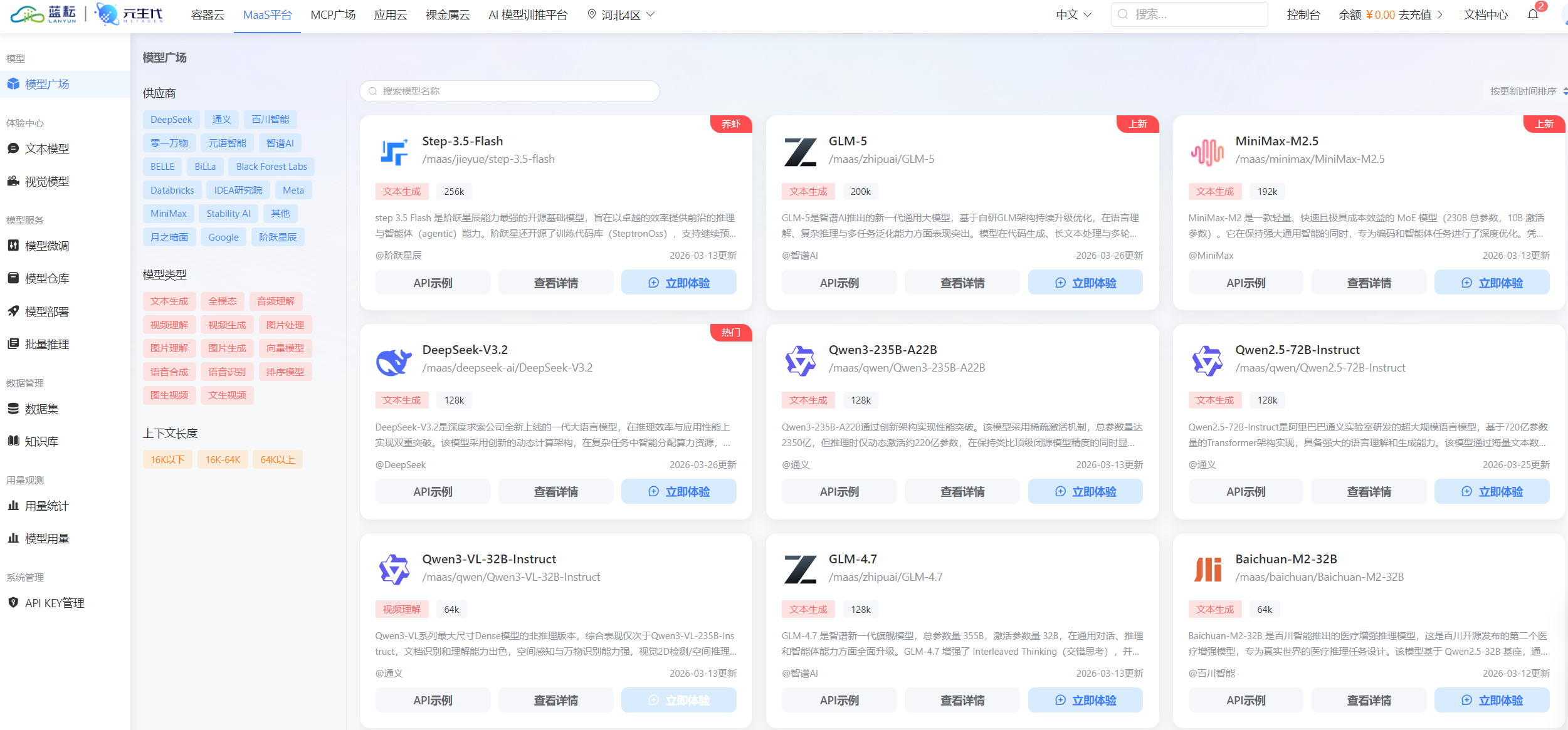

对企业而言,批量采购Token的核心需求,聚焦于可直接上线、稳定运行、持续迭代的生产级模型服务,更关注模型的实际业务适配性,而非单纯的数量堆叠。基于这一导向,蓝耘元生代云MaaS采用精品化模型策略,聚焦26+经过生产环境验证的主流旗舰模型,覆盖通用对话、代码生成、长文本处理、多模态理解、向量嵌入与重排序等多元业务场景。每一款模型均已完成推理性能优化、高并发适配及安全合规加固,可无缝接入企业生产环境。

同时,蓝耘全量支持Function Calling与流式输出SSE,满足Agent、实时流式回复等企业主流开发场景;行业新模型发布后,同步完成上线适配,核心模型实现首发支持,确保企业始终使用最新能力。

开箱即用的AI大脑:蓝耘MaaS热门旗舰模型精析

蓝耘元生代MaaS平台聚焦高使用率、高口碑、高性能主流模型,构筑覆盖通用场景与垂直领域的全栈模型生态,通过统一的API接口,将前沿AI能力封装为开箱即用的服务,无需额外适配即可快速使用。以下为核心模型能力与场景价值,所有模型均已完成深度性能调优:

DeepSeek-V3.2:数学推理与代码生成的“性能标杆”

模型特性:采用MoE架构,总参数671B,激活参数仅37B。推理与Agent能力逼近GPT-5,SWE-Bench编码测试得分73.1%,推理成本仅为GPT-5的1/24。

核心优势:专治“逻辑混乱”与“代码幻觉”,无论是复杂的金融建模,还是高难度的算法竞赛,均能提供类人推理的高准确性。根据权威AI性能测试平台AI Ping于2026年3月31日发布的最新评测,搭载于蓝耘元生代云MaaS平台的DeepSeek-V3.2模型,以1.14秒的响应延迟实现断层式领先;近7日(3月25日至4月1日)吞吐量均值达109.85 tokens/s,稳居参评平台首位。

GLM-5.1:开源代码智能体的“工程级突破”

模型特性:长程自主,架构高效。采用MoE架构,总参744B,激活约40B。原生支持200K超长上下文,基于昇腾芯片训练,MIT协议开源。可单次持续自主工作8小时,执行超1200个步骤,交付完整工程成果。

核心优势:代码能力登顶,成本极优。SWE-bench Pro达58.4%,超越GPT-5.4与Claude Opus 4.6,开源模型首次登顶。支持本地私有化部署。

MiniMax-M2.5:真实世界生产力与软件工程的“实战派”

模型特性:总参数229B,激活10B,SWE-Bench Verified得分高达80.2%,比肩Claude Opus 4.6。

核心优势:擅长真实场景下的业务逻辑实现与API调用编排。在构建企业级RAG(检索增强生成)和工作流自动化中,表现出极高的工具调用准确率。

Kimi-K2-thinking:长文本与深度推理的“专家”

模型特性:原生支持256K上下文,可实现百万字级文档一站式无截断处理;采用MIT许可证,具备极强的思维链推理能力,复杂问题解析更精准稳定。,

核心优势:解决“记不住”与“推不准”的问题。在处理超长文档问答、跨文档信息抽取时,能保持极高的召回率与逻辑连贯性,是法律文档、数据集分析与学术研究的利器。

Qwen3-VL-32B-Instruct:视觉理解与GUI自动化“多模态旗舰”

模型特性:原生多模态融合架构,而非简单的“文本+视觉外挂”。MMLU得分87.1%,支持高达256K上下文。

核心优势:打通“视觉”到“动作”的闭环。不仅能看懂图表,更能理解GUI界面并执行自动化操作,是财税票据处理、自动化测试的最佳拍档。

真正的护城河:“API+算力”的一体化演进路径

在企业批量采购Token的决策中,迁移成本是最容易被忽视的隐性成本。

企业AI业务通常遵循“原型验证→小规模上线→规模化部署→私有化隔离”的演进路径。而市面上多数纯 API 聚合平台仅提供基础接口转发服务。当业务进入规模化阶段,往往需要更换服务商、改造接口、甚至重新适配底层算力,整体迁移成本高昂。

蓝耘元生代MaaS依托自建的万P级智算中心,提供“共享API+专属资源池+私有化部署”全栈方案,形成一体化演进路径:

初创/测试期:通过MaaS API快速接入,新用户可申领500万免费Token额度,兼容OpenAI及Anthropic API,仅需修改地址与密钥即可上线,快速完成原型验证。

规模化期:业务增长后,可无缝迁移至专属资源池,API接口及业务代码均无需改造,实现零成本升级。

合规期:针对金融、医疗、政务等高敏感场景,支持私有化部署,确保数据不出域,满足等保、ISO 27001等合规要求。

在技术支撑层面,共享API层支持自动弹性扩容,峰值并发可在5分钟内扩展至10倍;专属资源池支持按需扩容,可实现2小时内快速新增GPU节点。这套平滑迁移体系,从根本上解决了企业在“选型→扩容→合规”各阶段的核心痛点,确保企业在Token采购与模型选型上的投入,不会因业务增长而沉没,真正实现“一次接入,持续演进”,而这也是蓝耘区别于纯API聚合平台的核心壁垒。

选型实战:构建可生长的AI基础设施

对于正在评估大模型API服务商的企业,我们建议采用“三层漏斗”筛选法开展稳健选型:

第一层(基础层):优先评估服务商是否具备自有算力底座。依托自有 AIDC 智算中心的服务商,在高并发场景下通常具备更稳定的资源保障能力,也更易支持从公有调用向私有化部署的平滑升级。

第二层(核心层):考察模型生态的“有效密度”。

模型数量的多寡并非唯一衡量标准。建议重点关注服务商是否已上线企业实际需要的主流旗舰模型,并结合自身业务场景验证推理性能与稳定性表现。

第三层(应用层):核查从共享API到专属资源的迁移适配能力。

可与服务商确认:业务从共享API环境迁移至专属资源池时,所需的代码改造量、接口适配成本与切换方案。以此评估其迁移路径的平滑度与兼容性。

Token经济时代下,企业实现可持续成本优化的核心,来自于架构的统一与业务的连续性。蓝耘元生代MaaS平台不仅是便捷的模型调用通道,更是一套可伴随企业从0到1、从1到100持续成长的AI基础设施。在这里,模型不仅是技术工具,更是驱动业务创新的可即用型能力引擎。