新闻中心

关注蓝耘了解更多咨询

2026年4月16日至18日,以“Agentic AI时代的软件工程重塑”为主题的QCon全球软件开发大会·2026北京站隆重举行。本次大会汇聚了来自阿里、腾讯、字节等一线科技企业的技术专家,共同探讨Agentic AI时代软件工程的重塑路径。

作为AI算力基础设施领域的创新代表,蓝耘科技携前沿实践经验亮相大会。在“大模型算力优化”专题中,蓝耘CTO安江华受专题出品人汤雄超博士邀请发表题为《支撑千亿Tokens/日的推理调度系统:MaaS网关的工程实践》的主题演讲,向业界分享了蓝耘在应对AI算力海啸中的关键技术突破与系统性思考,引发现场热烈反响。

01 千亿级Tokens背后,是一场算力效率的硬仗

当AI大模型从实验室走向千行百业,真正的考验才刚刚开始——每天千亿级Tokens的推理调用量,对底层基础设施提出了极其严苛的要求。网络接入的稳定性、计算资源的调度效率、GPU算力的利用率,每一个环节都是决定服务质量的关键战场。安江华指出,在单日千亿级Tokens调用的规模下,MaaS网关面临着三大极致考验:

- 网络连接的“最后一公里”瓶颈

- 计算资源的“忙闲不均”困境

- 昂贵算力的“利用率”难题

这些并非理论推演,而是蓝耘在真实的大规模生产环境中,日复一日面对和解决的工程难题。

02 从"能用"到"好用",蓝耘交出了一份硬核答卷

面对这些挑战,蓝耘并没有选择简单的"堆资源"策略,而是从系统架构层面进行了深度设计。安江华在现场展示了蓝耘自研的四层MaaS网关架构——从用户接入、API网关、核心调度到后端推理服务,层层解耦、层层优化,构建了一条高效稳定的请求处理流水线。

在关键技术层面,蓝耘的实践覆盖了智能网络选路、压力感知调度、基于AI的智能路由、批量推理与闲时利用、跨域算力共享等多个维度。尤其值得一提的是,蓝耘创新性地引入了"用大模型调度大模型"的理念——通过轻量级模型实时分析请求意图,自动匹配最合适的推理资源,在保障服务质量的同时,大幅优化了成本结构。

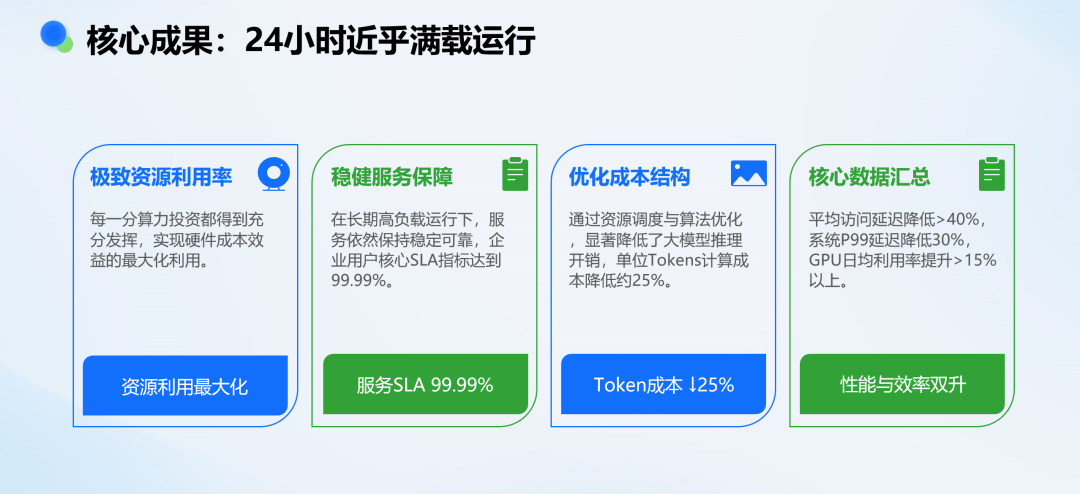

这些技术的叠加效果令人印象深刻:用户平均访问延迟降低超过40%,系统P99长尾延迟降低30%,GPU日均利用率提升超过15个百分点,服务SLA达到99.99%,单位Tokens计算成本降低约25%。更直观的成果是——蓝耘的固定GPU资源池实现了7×24小时近乎满载运行。

03 以快制快,应对AI市场的不确定性

稳定是基石,智能是核心,效率是目标

这是安江华在分享中反复强调的核心理念。在他看来,AI时代的竞争本质上是算力与效率的竞争,而蓝耘正在这条赛道上持续深耕。

他表示,人工智能市场变化极快,新技术热潮的迭代周期往往只有几个月。API网关的复杂设计虽然解决了调度效率,但要在适应市场快速变化的过程中跟着敏捷迭代,极其考验产研团队的技术响应速度。蓝耘的解法是通过统一网关模块化设计,快速兼容新协议,确保MaaS服务始终跟上AIGC的演进步伐。

当然,一篇文章无法完整呈现这套系统背后所有的技术细节与工程取舍。安江华在现场也分享了许多更深入的架构思考和实战经验,包括评分算法的设计哲学、动态惩罚机制的调优策略、异构计算的未来布局等,每一个话题展开都值得深聊。

如果您对蓝耘在AI算力调度领域的工程实践感兴趣,欢迎与我们面对面交流,深入探讨合作的可能。