新闻中心

关注蓝耘了解更多咨询

随着AI大模型的军备竞赛从"参数规模"转向"落地效率",企业关注的核心已从 “模型能实现什么能力”,转变为“如何让模型跑得更快、更省、更稳”。居高不下的推理成本、难以达标的响应延迟、门槛高昂的硬件投入 —— 这三大痛点,正成为横亘在大模型规模化落地道路上最现实的“拦路虎”。

Gartner预测,2026年将有70%的企业级 AI 应用基于轻量化模型部署;轻量化技术可将推理成本降至原来的1/10~1/15,模型体积压缩至35%仍能保留95%以上的性能。

在这场"降本增效"的技术攻坚中,剪枝、蒸馏、量化并称为大模型轻量化的"三驾马车"。而其中,剪枝+蒸馏的组合,被证明是在精度保留、吞吐提升与成本控制之间取得最优平衡的技术路径——它不仅是破解大模型部署成本魔咒的关键路径,更是直接决定企业AI业务ROI的生命线。

技术深潜:剪枝与蒸馏的“减法”艺术

如果说量化是给模型“降精度”(如FP8/INT8),那么剪枝与蒸馏则是从结构上动刀,实现真正的“减脂增肌”。

模型剪枝:神经网络的“精准瘦身术”

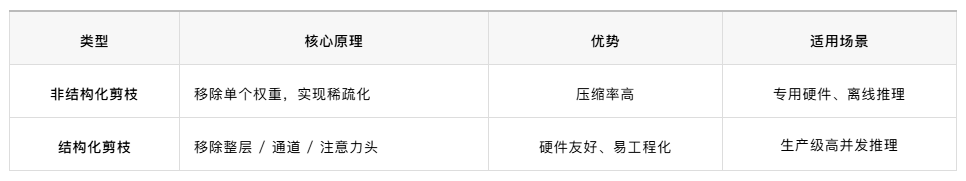

剪枝通过评估参数重要性,剔除对输出贡献微弱的冗余结构,在精度可控范围内实现参数量与计算量的双降,让模型在通用硬件上“健步如飞”。相较于早期非结构化剪枝带来的硬件加速难题,2026年的技术前沿已聚焦于结构化剪枝,通过“结构化剪枝+稀疏训练”,让剪枝粒度更规整,硬件友好度更高,推理更高效。

知识蒸馏:小模型学出大能力

知识蒸馏以大模型为“教师”,训练轻量化“学生”模型,通过软标签传递类别关系、不确定性等“暗知识”,让小模型逼近大模型效果。

- 核心架构:教师模型→软标签/特征蒸馏→学生模型→精度对齐

- 前沿方案:多教师协同蒸馏、注意力蒸馏、自蒸馏

- 效果:体积缩小60%~80%,推理成本降低70%+,性能保留95%+

组合效果:轻量化 “黄金组合”

剪枝负责“减冗余”,蒸馏负责“保能力”,叠加FP8量化后,对于规模化部署具有决定性意义:

- 模型体积压缩至20%~35%

- 推理成本降至1/10~1/15

- 吞吐量提升2~3倍

- 延迟降低60%+

工程化困境:自研轻量化为何难落地

技术门槛的跨越,并不意味着工程鸿沟的填平,企业自研轻量化模型,往往受困于三大现实瓶颈:

- 技术门槛高:需精通剪枝策略、蒸馏损失、量化校准,调参周期长

- 硬件适配难:优化模型需与 GPU、推理引擎深度适配,兼容性差

- 运维成本高:迭代、监控、扩缩容需专职团队,中小厂难以承受

高效破局方案:将轻量化优化技术封装至 MaaS 平台,企业实现零基建投入、低代码接入,开箱即用调用成熟优化模型,大幅降低轻量化落地门槛。

蓝耘MaaS全栈优化:轻量化+高性能+低成本

很多企业发现,自己压缩的模型在单机测试时很快,一旦上线面对真实流量洪峰,要么延迟飙升,要么显存溢出。这其中的技术鸿沟在于底层架构的适配。蓝耘元生代云MaaS基于自有GPU算力+模型服务一体化平台,深度集成剪枝、蒸馏、量化全链路优化,为企业提供生产级轻量化推理服务。

技术集成:三大轻量化能力内置

- 剪枝优化:结构化稀疏剪枝,自动适配DeepSeek、GLM等主流模型,压缩率40%+

- 知识蒸馏:多教师蒸馏引擎,提供官方同款精度的轻量化版本

- 量化加速:FP8无损量化,显存减半、吞吐翻倍,精度损失<1%

性能实测:第三方AI Ping权威数据(2026.4.2-4.9,DeepSeek-V3.2)

- P90延迟0.87秒:20+服务商中断层第一,比第二名快近3倍

- 7日平均吞吐109.85 tokens/s:持续稳定排名第一

- 最低吞吐 81.37 tokens/s:优于多数平台平均值,稳定性拉满

- 最大输出 128k:长文本场景领先

成本优化:比自建部署降低60%+

- 批量推理5 折,缓存命中价降低80%+

- 共享 API→专属资源池平滑迁移,无代码改造

- 新用户可申领500万免费Token,快速验证业务

全栈架构支撑性能领先

- 硬件:全国万P级AIDC智算中心,自有GPU集群,无资源超卖、无第三方中转

- 引擎:深度优化vLLM,PagedAttention管理KV Cache,GPU利用率达95%+

- 调度:动态批处理+智能网关,5分钟扩10倍并发,2小时扩容专属节点

企业级选型指南:避开“伪优化”陷阱

在选择MaaS平台时,企业不应只看标价,而应关注“有效算力”。基于蓝耘的实践,这里提供三条选型参考:

- 审视技术栈深度:确认服务商是否具备自有算力基础设施。纯代理平台无法控制底层硬件,往往难以发挥剪枝模型的极致性能。

- 关注长文本能力:剪枝技术容易损害长文本连贯性。蓝耘平台支持128K超大上下文(可扩展至200K),确保“瘦身”模型依然拥有出色的“记忆力”。

- 验证批量推理成本:对于非实时任务,蓝耘MaaS批量推理功能通过集中调度,能进一步将推理成本直降50%,是数据清洗、大规模离线生成场景的“成本杀手”。

蓝耘MaaS,让企业零门槛解锁性能与成本红利,将每一毫秒的延迟压缩与每一Tokens/s的吞吐提升都直接转化为看得见的业务竞争力。