新闻中心

关注蓝耘了解更多咨询

生成式AI席卷产业的当下,Token,这个AI理解与生成信息的最小单位,被英伟达誉为AI时代的“新石油”,国家数据局亦正式将其中文定名“词元”,奠定其智能时代价值锚点的地位。

数据显示,我国AI Token调用量两年内增长超千倍,2026年3月日均突破140万亿,推理侧需求爆发让Token从技术参数变为产业链核心战略资源,直接驱动算力服务范式的根本性变革。

Token:AI时代的价值度量衡

如果把AI大模型比作一座精密运转的工厂,Token就是流水线上最小的加工单元。它可以是一个词、一个字,也可以是一个标点或一个词根。当你说“你好”,模型看到的可能是“你”,“好”两个Token。而Token的生产与处理效率,也直接决定了AI能力的强弱。当用户向AI提问,模型将输入文本"切分"为Token序列,经过数十亿次运算后,再逐个Token生成回答。

将Token比作“新石油”恰如其分:

它是“工业”的原料:如同石油经过提炼才能驱动工业革命,海量的Token经过大模型“炼化”,才能转化为强大的智能。

也是价值的“载体”:在AI经济中,Token不仅是信息单位,更是连接算力供给与商业需求的一种可量化的价值单位。每一次模型调用、每一次智能问答、内容生成,本质上都是Token的生产与消耗。围绕Token构建的经济生态,有望在未来创造高达百万亿美元级别的价值。

算力跃迁:从硬件堆砌到Token驱动

如果说Token是AI时代的石油,那么算力就是那座庞大而精密的炼油厂。没有充沛、高性能的算力支撑,海量Token就只是一堆未经提炼的原油,无法转化为驱动创新进步的真正动能。

传统算力服务“堆硬件”式的线性供给,就像用几口大锅处理原油,不仅效率低下,且成本高昂、管理粗放。面对AI大模型动辄万卡并行、弹性调度、高密推理的复杂需求,这种模式已力不从心。当AI算力需求从“可用”迈向“好用”,市场真正渴求的,是“单节点大规模的可消费算力”:

稳定可得:能够应对长时间的训练任务,保障业务连续性。

弹性可配:业务峰值快速扩容,低谷时灵活缩容,告别资源闲置。

成本可控:从“买硬件”的资本支出,转变为“按需付费”的运营支出,实现投入产出最大化。

性能可验证:服务稳定可预测,性能指标清晰可量化。

这正是推动算力服务模式从“批发租赁”向“按量计费”跃迁的根本动力,也将算力从“冰冷的硬件”重塑为可计量、可交易、可高效消费的AI能力服务。在这一演进中,以Token为核心的精细化算力服务,成为贯穿始终的统一的价值度量与流转载体。

以“Token工厂”为核心定位的新一代智算中心,通过液冷高密度部署、异构算力智能调度、全栈技术优化,实现Token的高效生产与供给。传统云计算按核时、存储容量计费的模式,在AI时代全面转向按Token消耗量结算——这把全新的算力标尺,正在重新定义算力的价值逻辑与服务范式。

MaaS破局:算力到Token的“输油管道”

MaaS(Model as a Service,模型即服务)作为Token时代的核心服务形态,扮演着“输油管道”的关键角色,它将算力“炼油厂”与Token“石油”封装为开箱即用的标准化API服务,屏蔽模型训练、部署、运维等复杂技术环节,让用户无需自建算力集群,也无需具备深厚的AI技术背景,即可按需调用顶尖模型能力,加速了业务创新与场景落地。

相较于IaaS、PaaS、SaaS,MaaS精准解决企业AI落地三大痛点,让AI能力褪去“技术特权”的外衣,成长为支撑千行百业的普惠型基础设施:

解决了“算力之困”:无需自建和维护昂贵的GPU集群。

终结了“部署之累”:复杂的模型下载、环境配置、API封装全部交由平台处理。

消除了“成本之惑”:按需付费,让每一分投入都清晰可算。

蓝耘元生代MaaS:AI能力触手可及的“更优解”

在这场Token叙事浪潮中,蓝耘以Token驱动、AI原生的技术架构,构建起从算力底座到场景应用的完整智算服务体系。

作为蓝耘Token服务中枢,蓝耘元生代云MaaS平台聚合DeepSeek、Qwen、GLM、Kimi、MiniMax 等主流大模型,通过标准化服务接口,为开发者与企业构筑起一条连接前沿AI能力与实际业务场景的高效、普惠的“AI输油管道”。

透明计费,成本优势显著

平台采用纯Token计费模式,无隐藏费用。以备受关注的DeepSeek-V3.2模型为例,其输入计价为¥2/M Token,输出计价为¥3/M Token。配合平台的实时用量看板,用户可直观监控Token消耗情况,实现成本的精细化管控,有效减少资源闲置。

在同等性能条件下,蓝耘的Token计费模式对于突发高峰流量、持续训练等中高频推理场景,具备较强的成本竞争力,同时在GPU性价比与服务灵活性方面优势显著。

全栈优化,断层领先

性能是衡量MaaS平台服务能力的核心标尺。蓝耘元生代云MaaS平台依托自建AIDC+全栈优化,针对推理引擎完成算子融合、动态批处理、KV Cache优化等多轮技术迭代,全面释放模型性能潜力。2026年1月,在权威AI性能测试平台AIPing的评测中,平台搭载的DeepSeek-V3.2模型以 217.48Tokens/s的吞吐量登顶榜首,较第二名实现近两倍领先;GLM-4.7模型也以179.44 Tokens/s 稳居第一。这意味着,无论是高并发的实时交互,还是海量数据的离线处理,平台都能提供极速流畅的用户体验——让每一次模型调用,都经得起性能的考验。

极简易用,多场景适配

API兼容:平台深度兼容OpenAI/Anthropic标准接口,只需修改API Key和Base URL,即可实现无缝迁移;

部署灵活:支持公有云、私有化、混合云部署,满足金融、医疗等数据合规需求;

生态丰富:覆盖文本生成、图像分析、工具调用等多模态能力,从通用场景到垂直领域形成完整谱系,无需额外适配即可快速使用。

规模化应用,降本增效

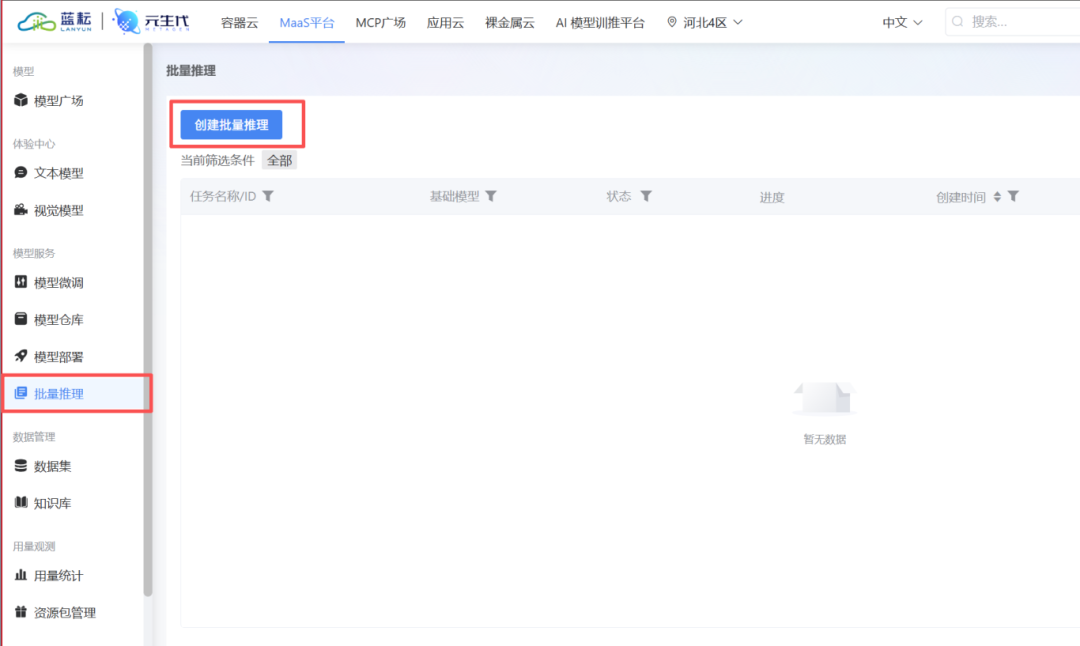

对于有海量离线数据处理需求的企业,蓝耘推出的批量推理功能提供了更优解。它将碎片化请求整合为规模化作业,在提升GPU利用率的同时,推理成本相比传统方案直降50%。

[uploading...]

灵活部署,安全合规

针对金融、医疗等高敏行业,蓝耘提供本地私有化部署方案,确保数据“不出域”。同时,平台已通过ISO27001信息安全管理体系认证,从数据加密、访问控制到容灾部署,全面构筑企业级的安全“防火墙”,让用户能够像使用内部系统一样,放心地调用顶尖AI能力,真正实现“数据可控,能力无界”。

蓝耘以Token驱动为核心价值,持续优化AI原生云架构,不断提升Token服务效能,助力更多企业与开发者高效触达前沿AI能力,推动Token价值落地为触手可及的创新动能。