新闻中心

关注蓝耘了解更多咨询

在AI研发进程中,从数据准备、模型训练到部署的全流程高效协作,已成为提升研发效能的迫切“刚需”。

蓝耘元生代AI模型训推平台(ai.lanyun.net)——提供从大规模分布式训练到高并发实时推理的全链路支撑,针对性破解算力不足、协作不畅、环境配置复杂等核心问题,全面加速模型迭代与部署,提升团队效能与资源利用率,为AI研发团队及开发者构筑高效、安全、可扩展的底座基石。

“从0到1”:直击六大研发痛点

1、算力动态调度,性能与成本双优化

支持单卡到百卡级分布式训练,显著提升训练速度,可动态调度GPU/AI芯片资源,满足高效计算需求。

提供包年包月的“专属资源组”服务,大幅降低使用成本,配备 RoCE无损网络,延迟低至微秒级,实现算力与成本的双重优化。

2、团队协作体系化,资源与数据安全可控

通过项目-资源-任务的分层权限架构,主账号可对全局资源进行集中管控,子账号可获细粒度的读写/只读权限分配,实现数据隔离与安全防护;实时算力看板直观呈现资源利用率、任务进度与存储状态信息,为高效协作提供有力支持。

3、环境一键配置,打造无缝开发体验

内置PyTorch、TensorFlow、PaddlePaddle等多款主流深度学习框架,支持自定义Docker镜像,实现分布式训练环境的一键式零门槛部署;通过开发环境一键克隆,新成员仅需5分钟即可快速上手,化解“代码环境不兼容”的团队协作难题。

4、数据与模型全生命周期管理

提供TB级存储空间,支持多模态数据存储,并内置数据合规审查功能,敏感数据自动脱敏。从训练到推理无缝衔接,大幅提升部署效率,保障数据与模型管理全流程高效、稳定运转。

5、资源配置灵活,资源利用率飙升

团队可根据实际需求灵活选择算力资源,避免资源浪费,显著降低研发运营成本,实现资源高效利用。

6、高效运维,专注研发创新

依托蓝耘在算力资源调度管理、性能优化及运维运营等方面的成熟服务经验,帮助用户屏蔽底层技术复杂度,让团队专注于AI研发与创新。

深入业务场景,释放AI生产力潜能

蓝耘深度聚焦垂直业务场景需求与挑战,打造专业的AI全流程开发支持服务:以某985高校人工智能研究院为例,其在多课题组联合研发语音交互大模型时,面临团队资源冲突、高峰期算力不足、语音数据安全防护与模型迭代等难题。蓝耘元生代AI模型训推平台为其定制解决方案:为各课题组创建独立项目,实现资源隔离,配置专属资源组保障日常训练,高峰期灵活调用公有资源弹性扩容, 避免算力争抢;通过镜像仓库封装包含语音处理库、方言数据集预处理工具的定制化环境,解决环境适配问题;同时开启存储加密与定期备份,确保语音数据安全;基于DeepSpeed分布式框架,支持模型与数据并行及断点续训,避免因突发状况导致的重复计算。依托蓝耘元生代AI 模型训推平台及专业团队服务,研究院显著缩短语音大模型训练周期,精准管控算力成本,在多课题组协同作业的复杂场景下,实现资源分配合理有序、研发全程零资源冲突与零数据安全隐患,项目稳步高效推进。

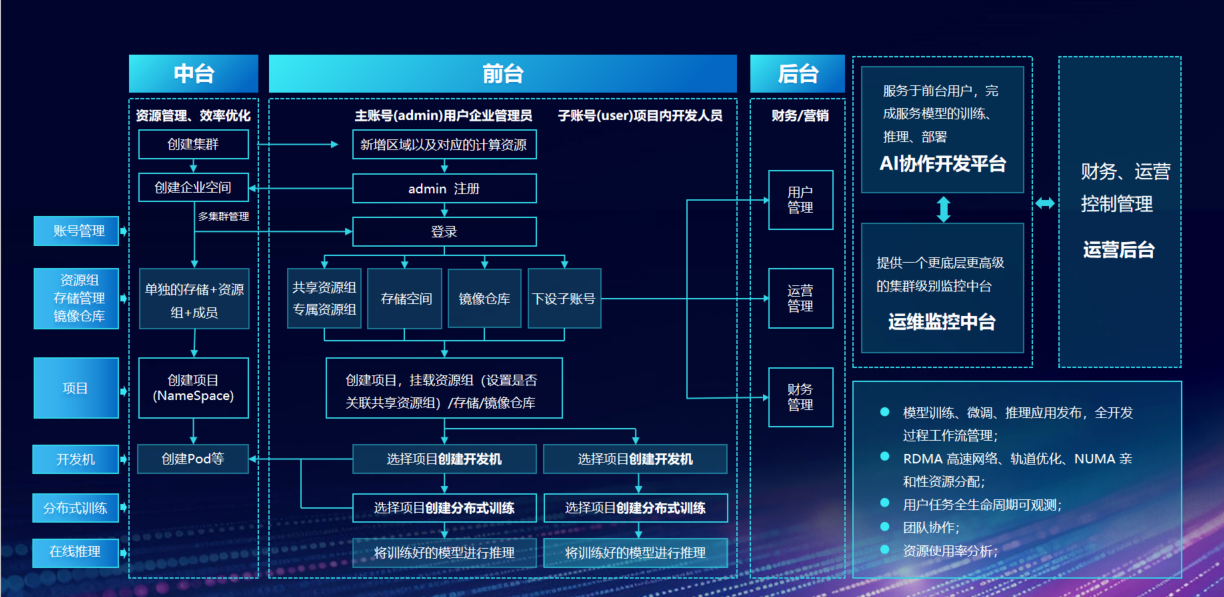

双模融合,灵动协同

蓝耘元生代AI模型训推平台作为面向AI开发者的一站式开发平台,通过前台、中台和后台的全方位协同, 满足多场景下模型训练与推理任务需求。面向团队用户,平台提供项目-资源(成员)-任务三层级敏捷架构,支持高效搭建、分区管理及成员协作;面向C端用户,平台配备丰富多样的框架组件、智简操作界面及高性价比GPU算力资源,加速释放创意潜能。

使用场景随需而变

场景A:单兵作战

独立开发者可直接创建开发环境、分布式训练任务、镜像仓库及存储空间,无需配置项目或专属资源组。

场景B:团队协作,项目隔离

针对团队或有项目隔离需求的个体用户,平台采用项目级资源隔离机制:由主账号统一负责资源采购与分配,子账号聚焦于模型训练与部署任务,无需参与硬件采购和运维,以实现资源管理与开发流程的分离式协作。

项目划分及资源分配

主账号使用流程

主账号集中配置GPU算力资源、存储及镜像环境,快速创建项目与子账号权限后,子账号基于分配资源即可进行任务创建、镜像保存等操作,实现资源与任务的无缝衔接。

子账号使用流程

主账号为子账号分配好项目后,子账号用户可使用专属资源组的资源、存储空间以及镜像仓库创建开发机、分布式训练任务和在线推理任务。

核心功能矩阵, 突破效率瓶颈

AI资产

专属资源组:包年包月高性价比资源集合,支持多项目共享。主账号可购买资源组并关联至一个或多个项目,子账号在所属项目下基于专属资源组创建开发环境、提交训练任务及部署在线服务,满足特定项目或团队的独立资源需求。

镜像仓库:提供镜像的全生命周期管理能力,该模块分为【镜像仓库管理】和【镜像仓库】两部分:主账号创建镜像仓库,子账号进行镜像管理,确保AI开发环境的一致性与可复用性。

存储空间: 提供文件存储的全流程管理服务,支持文件上传、删除及权限配置,为数据存储与共享提供安全、高效的解决方案。

项目管理:支持主账号对子账号进行创建、启用/禁用、项目分配等精细化权限管理,保障团队协作与数据隔离。

AI开发

开发机: 专为机器学习开发者打造的在线编译、调试代码及模型开发一体化模块。支持WebIDE与SSH双模式,持久化存储与弹性算力释放。为开发者提供高效、灵活的开发体验。

分布式训练:集成PyTorchJob、DeepSpeed等主流分布式训练框架,提供多类型资源调度与GPU算力自动分配管理,打造灵活易用的AI训练环境。用户只需上传代码并填写适量参数,即可快速启动分布式训练任务,实现零门槛高效开发。

AI服务

在线推理:助力用户将训练模型部署为线上服务,协同完善的日志监控及管理功能,确保用户实时掌握服务运行状态、精准排查问题。

模型库: 集成开箱即用的预训练模型,支持用户快速调用,加速开发进程。

人工智能技术浪潮奔涌,蓝耘元生代正以高效灵活的算力底座与AI开发工具链,推动AI研发从单点突破迈向团队协同,在加速技术创新与产业落地的征程中,携手行业伙伴共筑人工智能“燎原”生态。