新闻中心

关注蓝耘了解更多咨询

在大模型技术向产业纵深迈进的当下,将通用大模型的泛化能力与企业私域知识深度融合,已成为构建智能问答体系、释放数据资产价值的关键路径。蓝耘元生代云MaaS平台与开源AI应用开发平台Dify.AI的组合,正重新定义这一过程的效率边界——依托对DeepSeek-V3.2模型的全栈优化与高效接入能力,蓝耘元生代云MaaS平台与Dify形成深度协同,为用户打造从模型调用到本地知识库搭建的完整解决方案,无需复杂技术开发,即可快速实现“智能大脑+专属智库”的能力融合,让前沿AI技术真正成为触手可及的生产力工具。

蓝耘元生代云DeepSeek-V3.2:筑牢性能底座

构建知识库的首要前提是选择一个稳定且高效的基座模型。DeepSeek-V3.2在中文语义理解与长文本处理方面的优势已无需赘述,但真正决定其在实际场景中表现的,是承载它的MaaS平台性能。

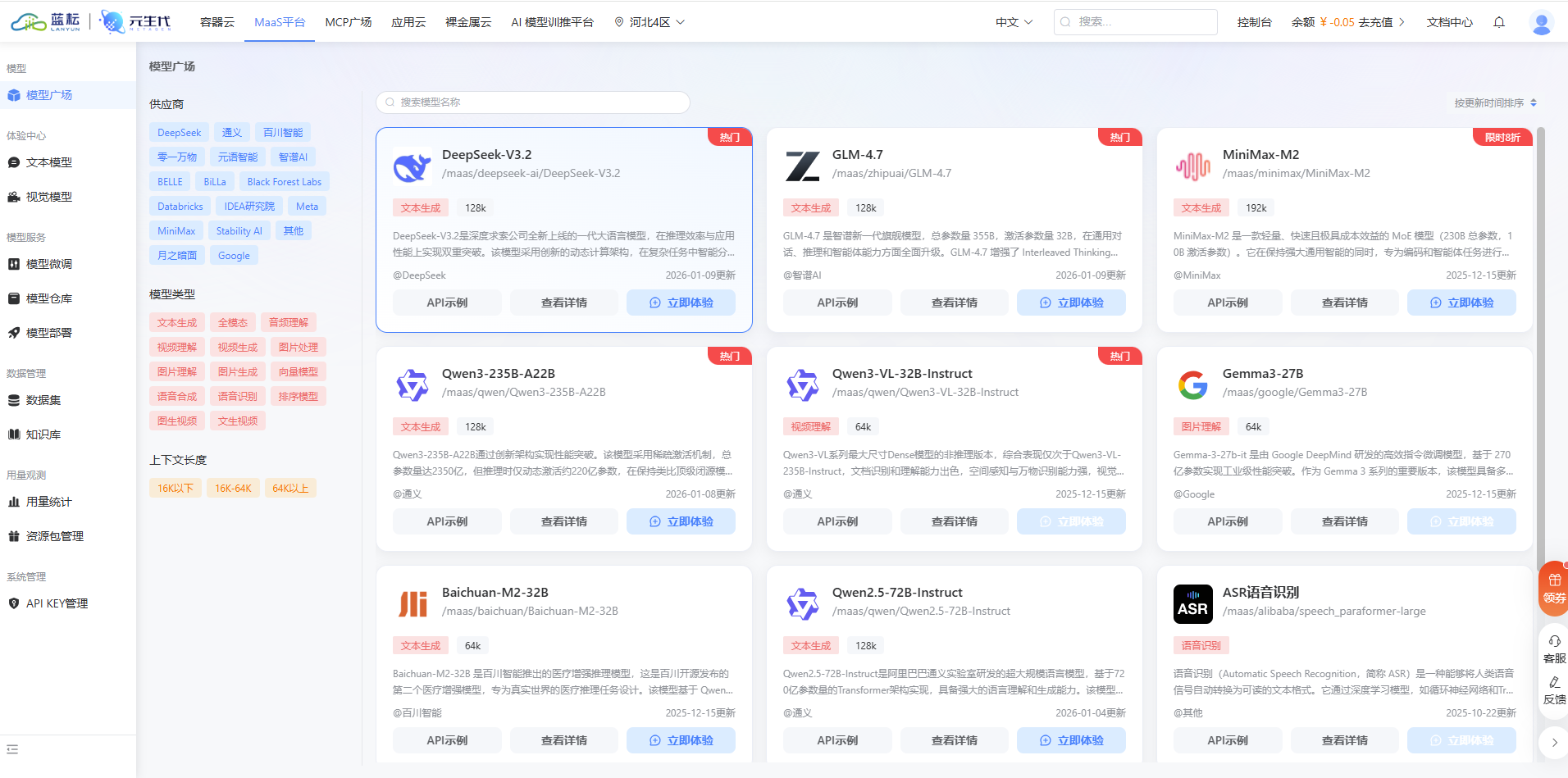

蓝耘元生代云MaaS平台面向企业团队、开发者及非技术用户,提供开箱即用的热门 AI 模型服务,支持零代码体验、API 快速调用与本地私有化部署,适配多样化应用需求。用户无需关注底层模型训练,即可获得专业级的AI技术支持。根据权威测试平台AI Ping于2026年1月发布的最新数据,蓝耘元生代云MaaS平台上的DeepSeek-V3.2模型以217.48 tokens/秒的吞吐量和0.38秒的超低延迟位居各大平台榜首。这意味着这意味着无论是实时对话还是复杂任务处理,模型能够以近乎实时的速度完成上下文构建,避免用户在问答过程中产生明显的“卡顿感”。同时支持128K超大上下文处理,可完成长文档深度分析、复杂逻辑推理等高阶任务,这种断层领先得益于蓝耘在硬件层面的全栈优化——从自建AIDC节点的GPU集群调度,到软件层面的算子融合与KV缓存优化,每一项技术调优都是为了将模型实力真正转化为用户手中的流畅体验 用户都能获得流畅体验。

Dify.AI:不止是工具链,更是知识中枢

如果说蓝耘MaaS提供了强大的“大脑”,那么Dify.AI则是连接大脑与数据的“神经系统”。作为一个开源的LLM应用开发平台,Dify支持可视化搭建 AI 应用、私有化知识库管理与RAG(检索增强生成)能力落地,可将复杂的RAG技术栈封装成了直观的“拖拉拽”工作流。

在搭建本地知识库的场景中,Dify主要扮演三个关键角色:

- 数据清洗与索引:支持上传PDF、TXT、DOCX等多种格式文档,并提供精细化的分段(Chunking)策略。你可以根据文档类型调整块大小与重叠率,确保语义完整性不被割裂。

- 混合检索与召回:结合向量检索的语义理解能力与关键词检索的精准匹配,大幅提升特定术语的召回准确率。

- 提示词编排:通过可视化界面设计复杂的提示词模板,让模型学会“如何阅读”你的知识库。

其与蓝耘元生代云MaaS平台的深度集成,可实现模型服务能力与轻量化应用开发的无缝协同,这一组合将底层技术复杂度有效屏蔽,让团队得以聚焦于核心业务逻辑的构建与私域知识的价值挖掘。

四步搭建:零门槛实现本地知识库部署

蓝耘元生代云MaaS平台全面兼容OpenAI API标准,与Dify.AI实现无缝对接,用户仅需完成简单的配置操作,即可快速搭建基于DeepSeek-V3.2的本地知识库,整个过程无需专业开发能力,真正实现零门槛接入。

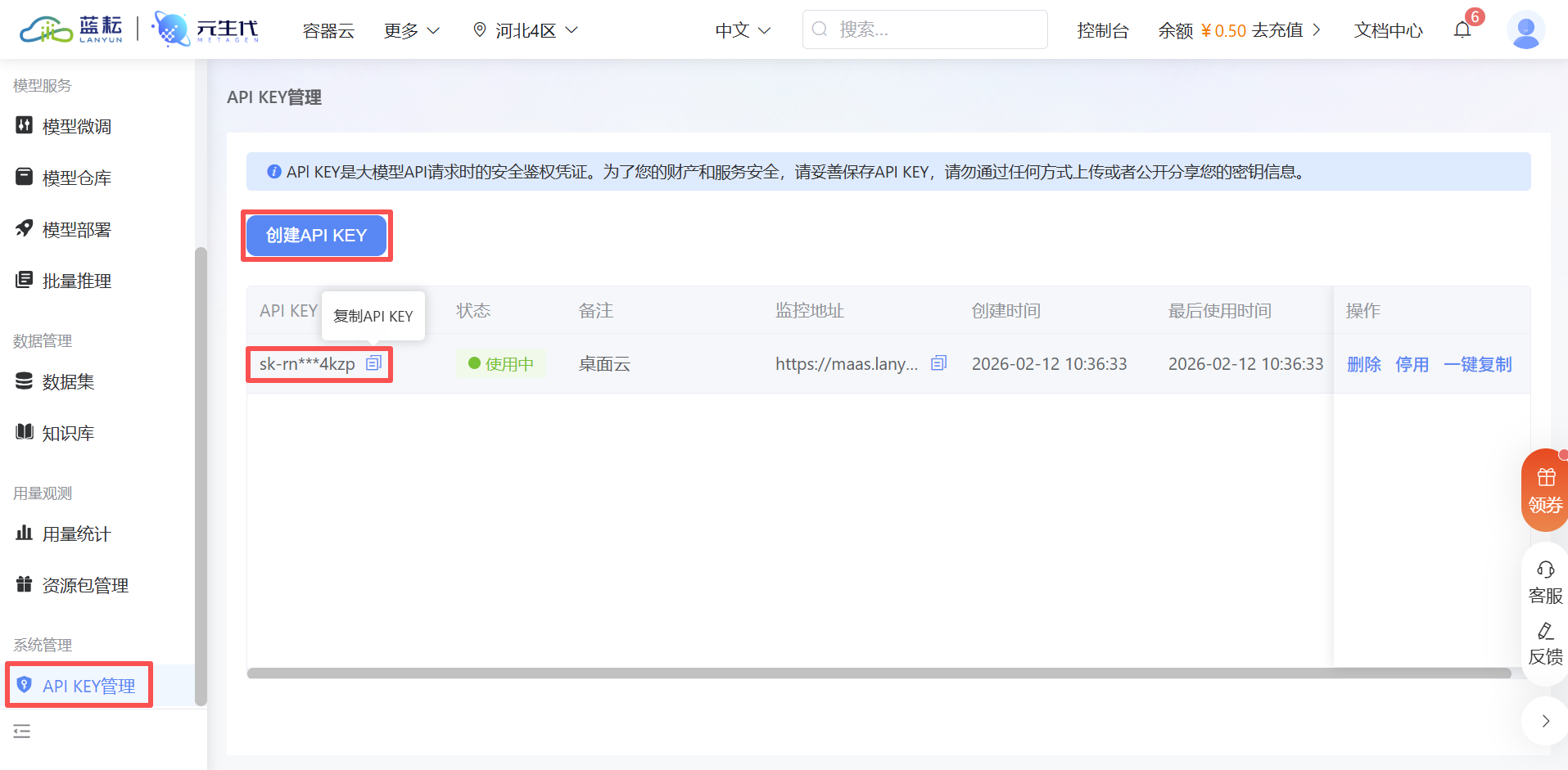

第一步:获取API密钥与接口信息

注册并登录蓝耘元生代云MaaS平台(https://maas.lanyun.net),进入「API开放平台-立即接入管理」,点击「创建API KEY」并完成自定义命名,即可获取专属密钥;同时可在平台查看DeepSeek-V3.2的标准接口信息,其API域名为https://maas-api.lanyun.net/v1,模型调用标识为/maas/deepseek-ai/DeepSeek-V3.2。

第二步:安装配置 Dify.AI 并对接模型接口

登录Dify平台,进入“设置”中的“模型供应商”页面。选择“OpenAI-API-compatible”,在配置项中,填入从蓝耘MaaS平台获取的API Key,API地址中输入https://maas-api.lanyun.net/v1。在模型选择中填入DeepSeek-V3.2对应的模型名称,保存即可完成对接。整个过程仅需简单修改配置,真正实现零学习成本迁移。

第三步:上传本地知识并完成智能向量化

在Dify.AI平台创建专属知识库,通过上传功能将本地PDF、DOCX等格式的业务文档导入,平台将自动完成文档的解析、分块与向量化处理,同时支持自定义知识分块规则与检索策略,确保模型能精准匹配并调用本地知识,解决通用大模型 “知识过时”与“不懂业务”的痛点。建议根据文档结构选择分隔符(如\n##用于标题分割),并将块大小设置在300-500字符之间,保留10%-15%的重叠度,以保证上下文的连贯性。

第四步:编排应用工作流

在Dify.AI中搭建问答应用,将已创建的知识库与DeepSeek-V3.2模型关联,选择「检索增强生成」模式,即可实现模型对本地知识的精准调用。用户在应用中提出业务问题,模型将结合自身推理能力与本地知识库内容生成答案,同时支持溯源查看答案对应的原文片段,确保回答的准确性与可验证性。此外在LLM节点中,将温度参数(Temperature)调低至0.3左右,能让模型更严格地遵循知识库原文,减少“幻觉”现象。

场景落地:让专属智慧大脑赋能多元业务

基于蓝耘元生代云DeepSeek-V3.2与Dify.AI搭建的本地知识库,可广泛适配企业内部培训、客户智能客服、技术文档问答、行业知识管理等多元场景。企业可将产品手册、售后案例导入知识库,打造7×24小时智能客服,快速响应客户咨询;科研机构可将论文、实验数据整合,实现科研知识的智能检索与分析;教育机构可搭建专属学科知识库,为师生提供个性化的知识问答服务。

从技术验证到产业落地,蓝耘元生代云MaaS平台始终致力于降低先进AI模型的使用门槛,通过与Dify.AI等热门应用平台的高效协同,让用户无需关注底层技术细节,即可快速实现大模型与本地知识的融合。这或许就是“让AI能力像水电一样触手可及”在知识库建设领域的最佳实践。