新闻中心

关注蓝耘了解更多咨询

随着生成式AI技术的不断纵深发展,AI大模型正经历着从单一模态向多模态、多任务深度融合的华丽转身。

这一里程碑式的跨越不仅拓宽了AI的感知与理解范畴,更引领着模型训练与推理侧算力应用的飞跃性升级。比尔·盖茨和OpenAI的CEO奥特曼在不久前的一场人工智能技术专题研讨中也特别提到,从“单模态”到“多模态”的技术演进将是未来通往AGI(通用人工智能)的必由之路。

多模态大模型 是一种基于深度学习的机器学习模型,类似于人脑能够同时处理文本、声音、图像等不同类型的信息,多模态模型能够处理和整合“图像+文本”、“视频+音频”、“语音+文字”等多种模态的数据和信息,利用不同模态之间的互补和协同,来提高模型的全面感知和泛化能力,使其能够应对更多复杂的任务和场景,以实现更好的性能表现。

相较于只能处理一种类型数据的单模态,多模态大模型在输入输出端的优势显著:不同模态的训练数据输入在快速拓展通用大模型能力边界的同时,可降低数据损耗和使用门槛,为用户带来体验提升;在输出端,多模态数据则简化了多模型的后期整合流程,加速大模型迈向商业化拐点。

作为通往AGI(通用人工智能)的关键路径,AI多模态在转动大模型“智能齿轮”的同时,进一步加速算力需求释放。与传统的单模态模型相比,多模态对算力供给提出了更高的要求。急剧飙升的算法复杂度及工程难度、模型迭代下动辄千亿规模的参数量和远高于单模态模型的大量图片、文本和视频数据集,不仅需要消耗大量计算资源,对算力的速度、精度、性能等方面的要求也水涨船高。

如何解读隐匿于多模态模型后的核心技术壁垒?怎样跨越多模态大模型训练、推理、调优场景下的 算力藩篱,助力技术突围“弯道超车”? 如何通过算力服务效能提升实现生产力的跃迁,进而满足多模态时代下不断攀升的高频算力需求,不仅是AI产业上下游探索突破的关键路径,也成为新一轮技术革新的焦点。下文试图通过四个不同维度来寻找这些问题的答案。

Q1: 生成式AI 正驶入多模态“航海时代”,基于技术与产品视角,如何定义多模态技术在生成式AI领域中的角色?

我们身处的世界本身就是多模态的。就像人类在理解世界的时候会协同运用视觉洞察、听觉捕捉与触觉体验等多重感知方式,多模态技术通过深度学习、 卷积神经网络 (CNNs)、循环神经网络(RNNs)及其变种(如Transformer等模型),可将源自多元渠道的各种数据类型(如图像、文本、音频、视频等)进行无缝融合,犹如一支通力协作、能够高效完成复杂任务的超级团队,其基于多层次的感知架构与跨模态的协作互补,可有效提升AI对复杂环境的感知与理解能力。

在生成式AI领域,多模态技术极大地提升了模型的生成能力,完成了AI从单一维度到多维交互的跨越性飞跃。其通过跨模态训练,可实现从一种模态到另一种模态内容的轻松转换,这一能力在拓宽AI的应用边界的同时,也大幅增强了其灵活性和创造力。

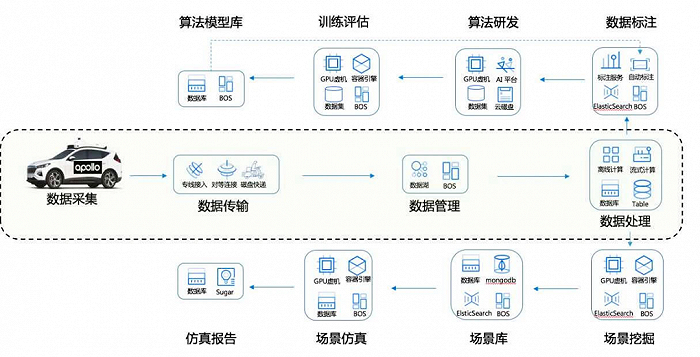

此外,多模态技术可通过联合表示学习(Joint RepresentationLearning),综合不同模态的数据,显著提升AI在决策制定及复杂问题理解上的精确度。例如,在自动驾驶中,AI可同时处理来自视觉、雷达、激光雷达等多个模态的数据,从而做出更安全的驾驶决策。

从产品视角来看,多模态技术不仅革新了用户体验、扩展了产品功能,更开辟了新兴应用场景,推动着个性化与定制化服务的进程,正引领产品向更智能、更个性、更沉浸的方向加速发展,为行业带来前所未有的变革与机遇。

Q2: 基于深度学习技术的多模态大模型可通过融合不同模态的数据信息,实现更加智能精准的决策和预测。其技术框架和主要实现方式有哪些?

从技术架构来看,多模态大模型以融合为核心,其技术实现是一个复杂且高度集成的过程,主要通过数据预处理、模态特征提取、融合、建模与学习、生成与预测等环节来实现复杂任务目标的高效输出。

首先将收集到的数据进行清洗和标注,并使用不同的神经网络(如CNN、RNN、Transformer等)从各个模态的数据中提取特征(包括文本、图像、音频、视频等),然后将各模态特征进行融合(根据数据融合阶段,可分为早期融合、中期融合和后期融合三个不同层级),再通过共享表示学习、对抗训练、多任务学习、无标注数据信息提取、跨模态生成与预测及对比学习等方式,将自监督学习和联合学习结合起来进行多任务学习,并协同注意力机制让多模态模型对不同模态进行动态的权重分配, 以便更精准地聚焦于任务目标中 的关键信息, 实现更高效的信息融合与处理 。

Q3: 多模态大模型催生出哪些算力新需求?将如何影响算力产业生态发展?

多模态技术蓬勃发展的背后,是对算力需求的水涨船高。其动辄数十亿甚至千亿规模的参数量和远高于单模态的海量数据集,需动用数以千计的GPU或TPU(Tensor Processing Unit)并行,以满足训练和推理过程中的高频计算需求,对集群式的高性能计算平台提出了更高的要求和挑战。

在实时图像识别、自动驾驶等多模态应用场景中,AI感知推理毫秒级响应需求及边缘计算也对实时算力和即时响应速度提出了严苛要求,低延迟、高吞吐量的计算基础设施及丰富的计算资源扮演着不可或缺的角色。

此外,多模态模型中大规模数据处理所涉及的 分布式存储 和高效传输技术,进一步推动了对分布式计算架构的依赖。

随着模型规模增加和算力需求的提升,计算过程中的能效优化随之成为挑战。专为多模态大模型量身打造的、能够提供更高计算效率和能效比的定制化芯片,也成为算力产业的重要发展方向。

逐级跃升的算力新需求不仅推动了数据中心、GPU云计算服务等算力基础设施的升级与扩展,也深刻地影响着算力市场格局和产业生态的发展,带来硬件与软件的深度整合、新技术的涌现、以及资本市场的高度关注。随着技术的不断进步,算力产业将迎来更加丰富和多样化的发展机遇。

Q4: 随着 多模态 技术的加速演进,AI大模型产业“齿轮”加速转动。其实际应用场景、未来发展趋势,以及面临的挑战分别有哪些?

多模态技术引发的深刻变革正悄然重塑生成式AI的应用边界。从创意产业、自动驾驶、具身智能到医疗诊断……,越来越多的行业生态正因多模态技术而焕发新生。

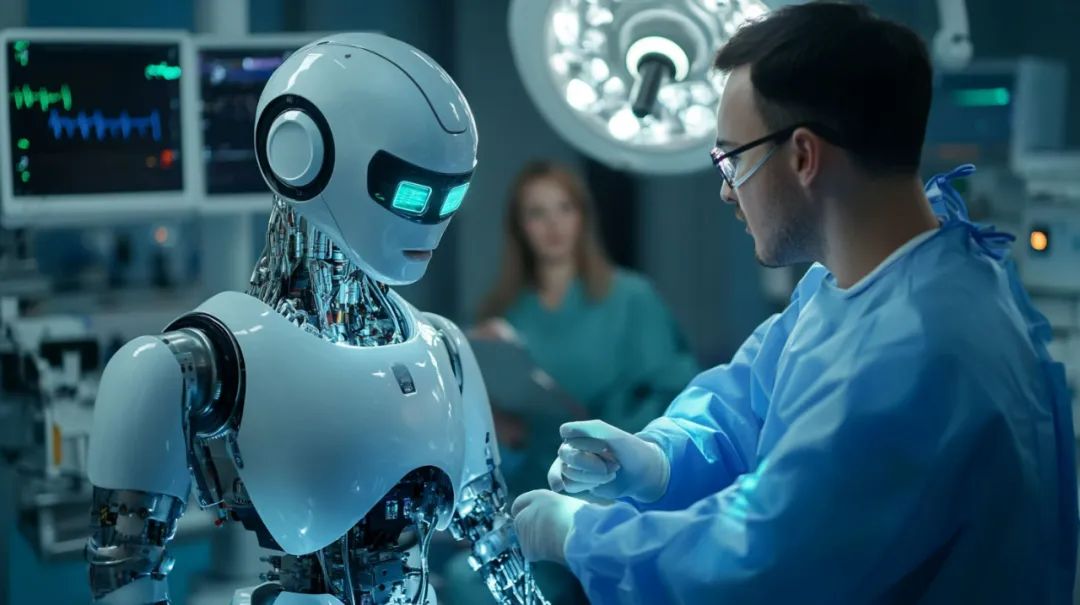

在内容创作领域,多模态技术可通过用户提供的图片与文本指令自动生成高度逼真的图像、视频,大幅度降低了创作门槛,激发了 内容产业 的创新潜力。 在机器人领域, 多模态 赋予了机器人更高级别的理解能力与执行能力,使其能够精准地响应、完成人类的多样化指令,增强了人机交互的流畅度与效率。 在自动驾驶领域,图像、雷达、GPS等多模态数据融合的能力,可帮助车辆更好地实现环境感知、路径规划和决策控制,全面提升自动驾驶系统的安全性和可靠性。

历经由单一数据类型处理的单模态到多种类型数据处理的演变更迭,多模态技术,未来有望进一步强化AI系统的跨模态学习与生成能力,以更有效地从多元类型数据中自主学习,并进行复杂的任务协作,同时将围绕边缘计算与分布式架构进行深入探索,以实现更快速、更高效的资源分配和服务响应。伴随着多模态技术的快速演进,模型规模与复杂度的持续攀升也将算力需求推向新的高度,驱动着硬件以及云计算服务市场空间加速释放。

然而,如何应对多模态大模型“智能涌现”下所伴随的数据质量、“黑箱化”属性及算力能耗挑战,保障数据安全和个人隐私,任重而道远。